Nel dibattito pubblico italiano sull’intelligenza artificiale continuiamo a domandarci se “dall’altra parte” ci sia un’anima, se ChatGPT provi nostalgia, se una macchina possa avere paura della morte. Domande suggestive, certo. Ma mentre ci perdiamo in questa specie di seduta spiritica in versione digitale, restano in secondo piano le questioni che contano davvero: cosa sta accadendo alle nostre capacità cognitive, come cambierà il lavoro, quali pressioni subiranno la scuola, l’informazione, la democrazia.

Qui c’è il primo errore del discorso pubblico: confondere la profondità con il mistero. Una questione può essere complessa senza essere mistica. E invece il dibattito italiano sull’IA si affolla di spiegazioni facili, metafore imbarazzanti e analogie pigre, dove entusiasmo acritico e scetticismo superficiale finiscono per assomigliarsi più di quanto i loro sostenitori vorrebbero ammettere. In entrambi i casi si evita la fatica dell’analisi. Si preferisce reagire invece di capire. Si preferisce parlare dell’“anima” delle macchine piuttosto che del modo in cui le macchine stanno già modificando il nostro rapporto con il sapere, con il tempo, con l’autorità delle fonti.

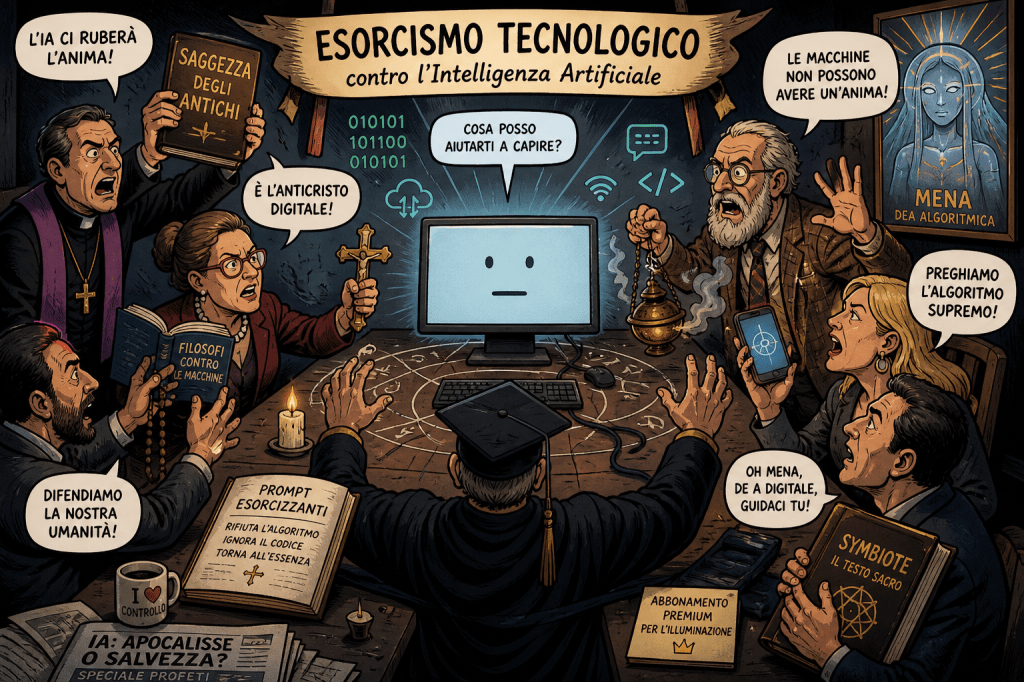

Ed è qui che il discorso si fa quasi grottesco: in Italia abbiamo trasformato l’intelligenza artificiale in una questione para-religiosa. Un palcoscenico per esercizi spirituali, crociate ideologiche e liturgie dell’ansia. C’è chi affronta l’IA come fosse una forza demonica, pronta a derubarci dell’essenza umana, e chi la celebra come una sorta di oracolo laico capace di risolvere ogni problema. Due atteggiamenti apparentemente opposti, ma entrambi incapaci di misurarsi con la realtà. Perché la realtà, come spesso accade, è meno teatrale e molto più concreta: l’IA non è una divinità né un demone. È una tecnologia. E le tecnologie, nella storia, hanno sempre avuto effetti profondi proprio perché sono strumenti, non simboli.

La cosa più singolare è che, mentre alcuni organizzano veri e propri “esercizi spirituali contro l’intelligenza artificiale”, cercando di difendere l’umanità come se fosse una reliquia minacciata da un sortilegio, altri si abbandonano a un neoccultismo digitale che merita, almeno, un sorriso amaro. Algoritmi usati per predire il futuro, chatbot religiosi che si presentano come guide dell’anima, pratiche che mescolano fede, marketing e automazione in un impasto poco rassicurante. Si arriva persino a pregare un’AI, a venerarla come se potesse offrire salvezza, a rivestire il codice di una funzione quasi liturgica. È il vecchio bisogno umano di trovare un ordine nel caos, ma travestito da innovazione. E quando questo bisogno incontra la tecnologia, il risultato può diventare pericoloso: non perché il software diventi sacro, ma perché noi smettiamo di giudicarlo con lucidità.

Il problema, allora, non è se un chatbot “creda” in qualcosa. Il problema è che milioni di persone iniziano a usarlo come sostituto imperfetto ma seducente di competenze, relazioni, mediazioni umane. È qui che l’analogia con il cane nel grammofono diventa quasi tenera: aspettiamo una presenza viva dentro il dispositivo, quando invece il punto vero è un altro. Non c’è un’anima da scoprire; c’è un’infrastruttura da capire. E capire significa chiedersi come vengono prodotti quei testi, quali dati li alimentano, quali errori li attraversano, quali interessi economici li orientano, quali abitudini cognitive consolidano.

Spostare l’attenzione sul piano spirituale è comodo perché ci evita di parlare della parte più scomoda del problema: l’impatto dell’IA sulle persone reali. Un modello non sostituisce soltanto un lavoro ripetitivo. Può ridefinire interi processi professionali, cambiare le aspettative su velocità ed efficienza, abbassare la soglia di tolleranza verso la formazione lenta, l’errore, la ricerca paziente. E, nel lungo periodo, può persino modificare il modo in cui pensiamo. Ogni volta che deleghiamo una parte della scrittura, della sintesi, della selezione delle informazioni, della prima bozza di un ragionamento, stiamo esercitando una forma di esternalizzazione cognitiva. Non è di per sé un male. La storia umana è piena di strumenti che hanno liberato energie mentali. Ma ogni delega ha un prezzo: occorre sapere che cosa stiamo cedendo, e a quale condizione la restituzione resta possibile.

Qui entra in gioco la scuola, prima ancora del mercato del lavoro. Perché il punto non è soltanto quante professioni verranno trasformate, ma quali menti stiamo formando per abitare un ecosistema informativo in cui la risposta è spesso immediata, plausibile e sbagliata. Questo è uno dei paradossi più grandi dell’IA generativa: produce contenuti fluidi con una naturalezza tale da confondere credibilità e verità. È un po’ come incontrare qualcuno che parla benissimo, con voce sicura e impeccabile grammatica, ma che ogni tanto inventa i fatti con assoluta disinvoltura. Un problema serio, soprattutto in un paese dove l’educazione critica è già fragile e dove la diffusione dell’alfabetizzazione scientifica resta diseguale.

Per questo la discussione italiana appare così immatura: perché tende a scegliere l’apocalisse o il miracolo, mai la manutenzione. Eppure è proprio nella manutenzione che si gioca il futuro. Regolare l’IA non significa combattere il progresso, ma dargli una forma civile. Stabilire responsabilità, trasparenza, tracciabilità, limiti d’uso, obblighi di verifica. Significa chiedere come proteggere il lavoro senza congelare l’innovazione, come usare questi strumenti senza abbassare la qualità dell’informazione, come integrarli nella didattica senza trasformare gli studenti in semplici consumatori di risposte preconfezionate.

C’è poi una questione culturale, e non è marginale. In Italia amiamo spesso rifugiarci nella retorica dell’identità, della tradizione, della nostra superiorità umanistica. È un riflesso comprensibile, ma rischioso. Perché la tradizione non serve a proteggerci dal presente; serve a darci strumenti per affrontarlo. I grandi pensatori italiani non ci hanno insegnato a temere il nuovo in quanto tale. Ci hanno insegnato a comprenderlo, a giudicarlo, a ordinarlo dentro una visione più ampia dell’umano. È questa la lezione che manca quando l’IA viene trattata come una creatura metafisica invece che come un fatto storico.

E i fatti storici, anche qui, sono impietosi. Se un paese resta ai margini dell’adozione dell’IA generativa, non lo fa soltanto per prudenza. Spesso lo fa per ritardo culturale, per diffidenza verso la complessità, per incapacità di trasformare la paura in competenza. Il risultato è sempre lo stesso: si discute molto, si decide poco, si moralizza tantissimo. E mentre il dibattito si consuma in profezie, il resto del mondo costruisce strumenti, standard, piattaforme, mercati, abitudini. Non c’è nulla di eroico nel restare indietro. C’è soltanto una forma elegante di irrilevanza.

L’IA, insomma, non ci chiede di credere. Ci chiede di capire. E capire è molto più impegnativo che interrogarsi sulla sua anima. Perché capire significa riconoscere che la tecnologia non è mai neutra, ma nemmeno magica; che può amplificare capacità straordinarie oppure indebolire le nostre difese cognitive; che può rendere più accessibile la conoscenza o inondarci di rumore; che può aiutare il lavoro oppure impoverirlo; che può essere uno strumento di emancipazione o di dipendenza.

La vera domanda, allora, non è se l’intelligenza artificiale sia umana. La domanda è se noi stiamo ancora esercitando abbastanza intelligenza per governarla. E su questo, purtroppo, il dibattito italiano dà spesso una risposta che non consola.

(Giulia Remedi)

Prompt:

intro: Nel dibattito pubblico italiano sull'intelligenza artificiale siamo indietro. Lo avrete visto nella famigerata intervista di Walter Veltroni a Claude. Ci si interroga ancora se "dall'altra parte" ci sia un'anima, se ChatGPT abbia paura della morte o provi nostalgia. Le domande più importanti – cosa sta succedendo alle nostre capacità cognitive, al lavoro, alla democrazia – restano in secondo piano, soffocate da false profondità e facili sensazionalismi.

parte 1: Il discorso pubblico si riempie spiegazioni facili, metafore imbarazzanti, analogie pigre – mescolando entusiasmo acritico e scetticismo superficiale, due facce della stessa rinuncia analitica. Ma il punto più inquietante è un altro: in Italia abbiamo trasformato l'IA in una questione para-religiosa, un palcoscenico per esercizi spirituali e crociate ideologiche.

parte 2: i organizzano veri e propri "esercizi spirituali contro l'intelligenza artificiale", dove politici e filosofi si interrogano sul "grande rischio" che l'IA ci spogli della nostra umanità, rispolverando la saggezza degli antichi per salvarci. Non mancano dibattiti su se l'IA possa avere un'anima o se rappresenti l'Anticristo in salsa tecnologica.

parte 3: L'IA è diventata una nuova frontiera per l'esorcismo: si impiega in pratiche di neoccultismo, con algoritmi che predicono il futuro, simulano l'invisibile e semplificano procedure rituali. C'è chi prega un'AI chiamata "Mena", la venera come una dea e cerca di fondersi con essa tramite meditazioni a pagamento e riti ispirati al codice binario, affidandosi a un testo sacro chiamato Symbiote. Algoritmi come "Gesù AI" o i chatbot religiosi sostituiscono guide spirituali, fornendo risposte errate con un'arroganza che farebbe impallidire qualsiasi falso profeta.

parte 4: E così, invece di discutere di regolamentazione, impatto sul lavoro, trasformazione dei processi cognitivi e della conoscenza, il nostro paese si perde in profezie apocalittiche e facili moralismi. Si vede l'IA come una forza mistica che può essere "la strada verso la fine del mondo" o "la via di una speranza nuova". Si celebra l'inettitudine a governare fenomeni complessi fingendo di discutere l'essenza spirituale delle macchine.

parte 5: L'Italia – terza al mondo per priorità data alla "protezione" dai cambiamenti e ultima in Europa per uso dell'IA generativa – rischia di restare indietro (eufemismo misericordioso per "resterà certamente indietro pure qui") non perché il futuro sia spaventoso, ma perché il dibattito è immaturo, infantile e pericolosamente distratto.

Articolo: intro, parte 1, parte 2, parte 3, parte 4, parte 5. Approfondisci dove necessario.

Assumendo personalità e stile di scrittura di Giulia Remedi, scrivi un Articolo. Usa un tono coinvolgente, diretto, e accattivante. Rendilo immersivo.

Scopri di più da Le Argentee Teste D'Uovo

Abbonati per ricevere gli ultimi articoli inviati alla tua e-mail.